Giáo trình Trí tuệ Nhân tạo part 4

Số trang: 8

Loại file: pdf

Dung lượng: 585.36 KB

Lượt xem: 19

Lượt tải: 0

Xem trước 2 trang đầu tiên của tài liệu này:

Thông tin tài liệu:

trong tìm kiếm theo bề rộng ta lần lượt phát triển tất cả các đỉnh ở mức hiện tại để sinh ra các đỉnh ở mức tiếp theo, còn trong tìm kiếm tốt nhất - đầu tiên ta chọn đỉnh để phát triển là đỉnh tốt nhất được xác định bởi hàm đánh giá (tức là đỉnh có giá trị hàm đánh giá là nhỏ nhất), đỉnh này có thể ở mức hiện tại hoặc ở các mức trên.

Nội dung trích xuất từ tài liệu:

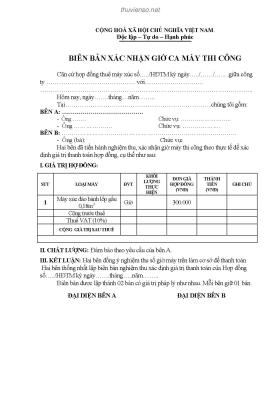

Giáo trình Trí tuệ Nhân tạo part 4bề rộng ở chỗ, trong tìm kiếm theo bề rộng ta lần lượt phát triển tất cả cácđỉnh ở mức hiện tại để sinh ra các đỉnh ở mức tiếp theo, còn trong tìm kiếmtốt nhất - đầu tiên ta chọn đỉnh để phát triển là đỉnh tốt nhất được xác địnhbởi hàm đánh giá (tức là đỉnh có giá trị hàm đánh giá là nhỏ nhất), đỉnh nàycó thể ở mức hiện tại hoặc ở các mức trên. Ví dụ: Xét không gian trạng thái được biểu diễn bởi đồ thị trong hình2.2, trong đó trạng thái ban đầu là A, trạng thái kết thúc là B. Giá trị củahàm đánh giá là các số ghi cạnh mỗi đỉnh. Quá trình tìm kiếm tốt nhất - đầutiên diễn ra như sau: Đầu tiên phát triển đỉnh A sinh ra các đỉnh kề là C, Dvà E. Trong ba đỉnh này, đỉnh D có giá trị hàm đánh giá nhỏ nhất, nó đượcchọn để phát triển và sinh ra F, I. Trong số các đỉnh chưa được phát triển C,E, F, I thì đỉnh E có giá trị đánh giá nhỏ nhất, nó được chọn để phát triển vàsinh ra các đỉnh G, K. Trong số các đỉnh chưa được phát triển thì G tốt nhất,phát triển G sinh ra B, H. Đến đây ta đã đạt tới trạng thái kết thúc. Cây tìmkiếm tốt nhất - đầu tiên được biểu diễn trong hình 2.3. Sau đây là thủ tục tìm kiếm tốt nhất - đầu tiên. Trong thủ tục này,chúng ta sử dụng danh sách L để lưu các trạng thái chờ phát triển, danhsách được sắp theo thứ tự tăng dần của hàm đánh giá sao cho trạng thái cógiá trị hàm đánh giá nhỏ nhất ở đầu danh sách.procedure Best_First_Search;begin1. Khởi tạo danh sách L chỉ chứa trạng thái ban đầu;2. loop do 2.1 if L rỗng then {thông báo thất bại; stop}; 2.2 Loại trạng thái u ở đầu danh sách L; 2.3 if u là trạng thái kết thúc then {thông báo thành công; stop} 2.4 for mỗi trạng thái v kề u do Xen v vào danh sách L sao cho L được sắp theo thứ tự tăng dần của hàm đánh giá;end;Tìm kiếm leo đồi: Tìm kiếm leo đồi (hill-climbing search) là tìm kiếm theo độ sâu đượchướng dẫn bởi hàm đánh giá. Song khác với tìm kiếm theo độ sâu, khi taphát triển một đỉnh u thì bước tiếp theo, ta chọn trong số các đỉnh con của u,đỉnh có nhiều hứa hẹn nhất để phát triển, đỉnh này được xác định bởi hàmđánh giá. Ví dụ: Ta lại xét đồ thị không gian trạng thái trong hình 2.2. Quá trìnhtìm kiếm leo đồi được tiến hành như sau. Đầu tiên phát triển đỉnh A sinh racác đỉnh con C, D, E. Trong các đ ỉnh này chọn D để phát triển, và nó sinhra các đ ỉnh con B, G. Quá trình tìm kiếm kết thúc. Cây tìm kiếm leo đồiđược cho trong hình 2.4. Trong thủ tục tìm kiếm leo đồi được trình bày dưới đây, ngoài danhsách L lưu các trạng thái chờ được phát triển, chúng ta sử dụng danh sáchL1 để lưu giữ tạm thời các trạng thái kề trạng thái u, khi ta phát triển u.Danh sách L1 được sắp xếp theo thứ tự tăng dần của hàm đánh giá, rồi đượcchuyển vào danh sách L sao trạng thái tốt nhất kề u đứng ở danh sách L.procedure Hill_Climbing_Search;begin1. Khởi tạo danh sách L chỉ chứa trạng thái ban đầu;2. loop do 2.1 if L rỗng then {thông báo thất bại; stop}; 2.2 Loại trạng thái u ở đầu danh sách L; 2.3 if u là trạng thái kết thúc then {thông báo thành công; stop}; 2.3 for mỗi trạng thái v kề u do đặt v vào L1; 2.5 Sắp xếp L1 theo thứ tự tăng dần của hàm đánh giá; 2.6 Chuyển danh sách L1 vào đầu danh sách L;end;Tìm kiếm beam Tìm kiếm beam (beam search) giống như tìm kiếm theo bề rộng, nóphát triển các đỉnh ở một mức rồi phát triển các đỉnh ở mức tiếp theo. Tuynhiên, trong tìm kiếm theo bề rộng, ta phát triển tất cả các đỉnh ở một mức,còn trong tìm kiếm beam, ta hạn chế chỉ phát triển k đỉnh tốt nhất (các đỉnhnày được xác định bởi hàm đánh giá). Do đó trong tìm kiếm beam, ở bất kỳmức nào cũng chỉ có nhiều nhất k đỉnh được phát triển, trong khi tìm kiếmtheo bề rộng, số đỉnh cần phát triển ở mức d là bd (b là nhân tố nhánh). Ví dụ: Chúng ta lại xét đồ thị không gian trạng thái trong hình 2.2.Chọn k = 2. Khi đó cây tìm kiếm beam được cho như hình 2.5. Các đỉnhđược gạch dưới là các đỉnh được chọn để phát triển ở mỗi mức. Chương III Các chiến lược tìm kiếm tối ưu --------------------------------- Vấn đề tìm kiếm tối ưu, một cách tổng quát, có thể phát biểu như sau.Mỗi đối tượng x trong không gian tìm kiếm được gắn với một số đo giá trịcủa đối tượng đó f(x), mục tiêu của ta là tìm đối tượng có giá trị f(x) lớnnhất (hoặc nhỏ nhất) trong không gian tìm kiếm. Hàm f(x) được gọi là hàmmục tiêu. Trong chương này chúng ta sẽ nghiên cứu các thuật toán tìm kiếmsau: Các kỹ thuật tìm đường đi ngắn nhất trong không gian trạng thái:Thuật toán A*, thuật toán nhánh_và_cận. Các kỹ thuật tìm kiếm đối tượng tốt nhất: Tìm kiếm leo đồi, tìm kiếmgradient, tìm kiếm mô phỏng luyện kim. Tìm kiếm bắt chước sự tiến hóa: thuật toán di truyền.1.8 Tìm đường đi ngắn nhất. Trong các chươ ...

Nội dung trích xuất từ tài liệu:

Giáo trình Trí tuệ Nhân tạo part 4bề rộng ở chỗ, trong tìm kiếm theo bề rộng ta lần lượt phát triển tất cả cácđỉnh ở mức hiện tại để sinh ra các đỉnh ở mức tiếp theo, còn trong tìm kiếmtốt nhất - đầu tiên ta chọn đỉnh để phát triển là đỉnh tốt nhất được xác địnhbởi hàm đánh giá (tức là đỉnh có giá trị hàm đánh giá là nhỏ nhất), đỉnh nàycó thể ở mức hiện tại hoặc ở các mức trên. Ví dụ: Xét không gian trạng thái được biểu diễn bởi đồ thị trong hình2.2, trong đó trạng thái ban đầu là A, trạng thái kết thúc là B. Giá trị củahàm đánh giá là các số ghi cạnh mỗi đỉnh. Quá trình tìm kiếm tốt nhất - đầutiên diễn ra như sau: Đầu tiên phát triển đỉnh A sinh ra các đỉnh kề là C, Dvà E. Trong ba đỉnh này, đỉnh D có giá trị hàm đánh giá nhỏ nhất, nó đượcchọn để phát triển và sinh ra F, I. Trong số các đỉnh chưa được phát triển C,E, F, I thì đỉnh E có giá trị đánh giá nhỏ nhất, nó được chọn để phát triển vàsinh ra các đỉnh G, K. Trong số các đỉnh chưa được phát triển thì G tốt nhất,phát triển G sinh ra B, H. Đến đây ta đã đạt tới trạng thái kết thúc. Cây tìmkiếm tốt nhất - đầu tiên được biểu diễn trong hình 2.3. Sau đây là thủ tục tìm kiếm tốt nhất - đầu tiên. Trong thủ tục này,chúng ta sử dụng danh sách L để lưu các trạng thái chờ phát triển, danhsách được sắp theo thứ tự tăng dần của hàm đánh giá sao cho trạng thái cógiá trị hàm đánh giá nhỏ nhất ở đầu danh sách.procedure Best_First_Search;begin1. Khởi tạo danh sách L chỉ chứa trạng thái ban đầu;2. loop do 2.1 if L rỗng then {thông báo thất bại; stop}; 2.2 Loại trạng thái u ở đầu danh sách L; 2.3 if u là trạng thái kết thúc then {thông báo thành công; stop} 2.4 for mỗi trạng thái v kề u do Xen v vào danh sách L sao cho L được sắp theo thứ tự tăng dần của hàm đánh giá;end;Tìm kiếm leo đồi: Tìm kiếm leo đồi (hill-climbing search) là tìm kiếm theo độ sâu đượchướng dẫn bởi hàm đánh giá. Song khác với tìm kiếm theo độ sâu, khi taphát triển một đỉnh u thì bước tiếp theo, ta chọn trong số các đỉnh con của u,đỉnh có nhiều hứa hẹn nhất để phát triển, đỉnh này được xác định bởi hàmđánh giá. Ví dụ: Ta lại xét đồ thị không gian trạng thái trong hình 2.2. Quá trìnhtìm kiếm leo đồi được tiến hành như sau. Đầu tiên phát triển đỉnh A sinh racác đỉnh con C, D, E. Trong các đ ỉnh này chọn D để phát triển, và nó sinhra các đ ỉnh con B, G. Quá trình tìm kiếm kết thúc. Cây tìm kiếm leo đồiđược cho trong hình 2.4. Trong thủ tục tìm kiếm leo đồi được trình bày dưới đây, ngoài danhsách L lưu các trạng thái chờ được phát triển, chúng ta sử dụng danh sáchL1 để lưu giữ tạm thời các trạng thái kề trạng thái u, khi ta phát triển u.Danh sách L1 được sắp xếp theo thứ tự tăng dần của hàm đánh giá, rồi đượcchuyển vào danh sách L sao trạng thái tốt nhất kề u đứng ở danh sách L.procedure Hill_Climbing_Search;begin1. Khởi tạo danh sách L chỉ chứa trạng thái ban đầu;2. loop do 2.1 if L rỗng then {thông báo thất bại; stop}; 2.2 Loại trạng thái u ở đầu danh sách L; 2.3 if u là trạng thái kết thúc then {thông báo thành công; stop}; 2.3 for mỗi trạng thái v kề u do đặt v vào L1; 2.5 Sắp xếp L1 theo thứ tự tăng dần của hàm đánh giá; 2.6 Chuyển danh sách L1 vào đầu danh sách L;end;Tìm kiếm beam Tìm kiếm beam (beam search) giống như tìm kiếm theo bề rộng, nóphát triển các đỉnh ở một mức rồi phát triển các đỉnh ở mức tiếp theo. Tuynhiên, trong tìm kiếm theo bề rộng, ta phát triển tất cả các đỉnh ở một mức,còn trong tìm kiếm beam, ta hạn chế chỉ phát triển k đỉnh tốt nhất (các đỉnhnày được xác định bởi hàm đánh giá). Do đó trong tìm kiếm beam, ở bất kỳmức nào cũng chỉ có nhiều nhất k đỉnh được phát triển, trong khi tìm kiếmtheo bề rộng, số đỉnh cần phát triển ở mức d là bd (b là nhân tố nhánh). Ví dụ: Chúng ta lại xét đồ thị không gian trạng thái trong hình 2.2.Chọn k = 2. Khi đó cây tìm kiếm beam được cho như hình 2.5. Các đỉnhđược gạch dưới là các đỉnh được chọn để phát triển ở mỗi mức. Chương III Các chiến lược tìm kiếm tối ưu --------------------------------- Vấn đề tìm kiếm tối ưu, một cách tổng quát, có thể phát biểu như sau.Mỗi đối tượng x trong không gian tìm kiếm được gắn với một số đo giá trịcủa đối tượng đó f(x), mục tiêu của ta là tìm đối tượng có giá trị f(x) lớnnhất (hoặc nhỏ nhất) trong không gian tìm kiếm. Hàm f(x) được gọi là hàmmục tiêu. Trong chương này chúng ta sẽ nghiên cứu các thuật toán tìm kiếmsau: Các kỹ thuật tìm đường đi ngắn nhất trong không gian trạng thái:Thuật toán A*, thuật toán nhánh_và_cận. Các kỹ thuật tìm kiếm đối tượng tốt nhất: Tìm kiếm leo đồi, tìm kiếmgradient, tìm kiếm mô phỏng luyện kim. Tìm kiếm bắt chước sự tiến hóa: thuật toán di truyền.1.8 Tìm đường đi ngắn nhất. Trong các chươ ...

Tìm kiếm theo từ khóa liên quan:

giáo trình Trí tuệ Nhân tạo bài giảng Trí tuệ Nhân tạo tài liệu Trí tuệ Nhân tạo đề cương Trí tuệ Nhân tạo lý thuyết Trí tuệ Nhân tạoGợi ý tài liệu liên quan:

-

Bài giảng Trí tuệ nhân tạo dành cho mọi người - ThS. Nguyễn Ngọc Tú

149 trang 50 0 0 -

Lecture note Artificial Intelligence - Chapter 16: Rational decisions

5 trang 37 0 0 -

Lecture note Artificial Intelligence - Chapter 20a: Statistical learning

3 trang 36 0 0 -

Lecture note Artificial Intelligence - Chapter 6: Game playing

7 trang 35 0 0 -

Lecture note Artificial Intelligence - Chapter 8: First-order logic

6 trang 35 0 0 -

Giáo trình Trí tuệ nhân tạo- Đại học Sư Phạm Hà Nội

35 trang 34 0 0 -

Giáo trình Trí tuệ nhân tạo: Phần 2 - ĐH Huế

74 trang 33 0 0 -

Lecture note Artificial Intelligence - Chapter 13: Uncertainty

6 trang 32 0 0 -

Lecture note Artificial Intelligence - Chapter 7: Logical agents

12 trang 32 0 0 -

Lecture note Artificial Intelligence - Chapter 5: Constraint Satisfaction Problems

7 trang 32 0 0