Đánh giá hiệu năng của thuật toán thay thế Web caching LRU-EXT cho internet Web caching sử dụng mạng tích hợp hàng đợi và Petri Net có thời gian

Thông tin tài liệu:

Nội dung trích xuất từ tài liệu:

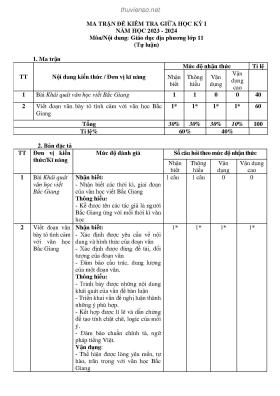

Đánh giá hiệu năng của thuật toán thay thế Web caching LRU-EXT cho internet Web caching sử dụng mạng tích hợp hàng đợi và Petri Net có thời gian Công nghệ thông tin<br /> <br /> ĐÁNH GIÁ HIỆU NĂNG CỦA THUẬT TOÁN THAY THẾ WEB<br /> CACHE LRU-EXT CHO INTERNET WEB CACHING SỬ DỤNG<br /> MẠNG TÍCH HỢP HÀNG ĐỢI VÀ PETRI NET CÓ THỜI GIAN<br /> Nguyễn Xuân Trường*, Hồ Khánh Lâm, Nguyễn Minh Quý<br /> Tóm tắt: Web caching là việc lưu trữ bản sao của những tài liệu web sao cho gần<br /> với người dùng; Web caching là ứng dụng ở cấp độ routing và phần lớn băng thông<br /> dùng cho web với mục tiêu làm tăng tốc độ đường truyền và tốc độ truy cập web.<br /> Các kiến trúc Internet web caching cùng với các chính sách thay thế Web cache là<br /> những giải pháp quan trọng và không thể thiếu được trong phát triển Internet nhằm<br /> đáp ứng các dịch vụ chất lượng cao. Một số thuật toán thay thế web cache như LRU,<br /> LFU, MRU… đã được ứng dụng từ lâu, tuy nhiên mỗi thuật toán đều có những ưu<br /> điểm và nhược điểm. Do đó, cho đến nay các nghiên cứu về thay thế Web cache vẫn<br /> còn được quan tâm. Thuật toán thay thế Web cache LRU-EXT đã được đề xuất [1]<br /> và đánh giá hiệu năng qua các ví dụ và công thức tính toán. Trong bài báo này,<br /> chúng tôi đề xuất sử dụng mô hình mạng tích hợp hàng đợi và Petri Net có thời gian<br /> chung để đánh giá hiệu năng của thuật toán LRU-EXT.<br /> Từ khóa: Internet web caching architecture; LRU-EXT; Hybrid model of Queue and GSPN.<br /> <br /> 1. MỞ ĐẦU<br /> Trong kiến trúc Web caching phân tầng (Hierarchical Web Caching) [2], chúng<br /> tôi lựa chọn kiến trúc lai và phân tích đánh giá hiệu năng sử dụng mô hình hàng<br /> đợi với các cấp cache: Institutional Caches (IC), Regional Caches (RC), Central<br /> Caches (CC), Original Caches (OC) [3]. Thời gian đáp ứng trung bình cho truy<br /> nhập HTTP trong một kiến trúc Web caching phân tầng của ISP đã được chúng tôi<br /> đề xuất trong [3]:<br /> E[ RWC ] E[ R3 H ] ( Miss3 )( E[ R2 H ] ( Miss2 )( E[ R1H ] ( Miss1 )( E[ R0 H ]))) (1)<br /> <br /> Trong đó: E[ R3 H ], E[ R2 H ], E[ R1H ], E[ R0 H ] - Thời gian đáp ứng truy nhập trung<br /> bình của các cấp cache tương ứng: IC, RC, CC, và OC; Miss3 , Miss2 , Miss1 - Tỷ số<br /> trượt cache (cache miss) ở các cấp cache tương ứng: IC, RC, CC, và OC.<br /> Sự thay thế Web cache được thực hiện khi trượt Web cache, nghĩa là khi đối tượng<br /> mà yêu cầu http từ người dùng (client http request) không có trong Web cache mà<br /> dung lượng của Web cache đã đầy không còn vùng trống để nhận vào đối tượng<br /> web mới từ Internet đáp ứng yêu cầu của người dùng. Quá trình thực hiện tìm kiếm<br /> nội dung web và thực hiện một thuật toán hay chính sách thay thế Web cache nói<br /> chung ở một cấp cache (ví dụ cấp IC) của kiến trúc Internet web caching được<br /> chúng tôi đề xuất trong [1] cho ở hình 1.<br /> Thuật toán LRU (Least Recently Used) chỉ đạt hiệu quả khi các đối tượng Web<br /> có kích thước giống nhau. Thực tế phụ thuộc vào chỉ số dân trí từng vùng, sự phát<br /> triển của các dịch vụ thông tin di động, xét theo Zipf [4]: Các hệ thống Web cache<br /> thiết lập ở đó cần có sự đầu tư về công suất, dung lượng để đáp ứng nhu cầu. Vậy<br /> <br /> <br /> 142 N. X. Trường, H. K. Lâm, N. M. Quý, “Đánh giá hiệu năng … và Petri Net có thời gian.”<br /> Nghiên cứu khoa học công nghệ<br /> <br /> nên mặc dù cùng cấp mạng nhưng các hệ thống Web cache sẽ khác nhau về dung<br /> lượng, công suất vì số lượng các website được ưa chuộng khác nhau, kích thước<br /> các đối tượng web cũng khác nhau.<br /> <br /> <br /> <br /> <br /> Hình 1. Tìm đối tượng Web ở cấp cache IC cho yêu cầu Client HTTP.<br /> Do đó không áp dụng các thuật toán LRU hay LFU (Least Frequently Used)<br /> một cách đơn thuần. Ngoài ra, có một số trang web có thể một thời điểm không<br /> được người dùng quan tâm, và dễ bị thay thế theo LRU hay LFU, nhưng sau đó,<br /> chúng lại có thể được sự bùng nổ số người tham chiếu đến. Khi đó theo LRU hay<br /> LFU những trang web này lại phải tìm kiếm qua mạng trên các hệ thống Web<br /> cache khác, mà chưa chắc đã tồn tại. Thực tế đã có đề xuất thuật toán MRU (Most<br /> Recently Used) đối tượng được sử dụng gần đây nhất là ứng viên bị thay thế [5].<br /> MRU được sử dụng khi cần phải truy cập đến thông tin lịch sử. Thuật toán của<br /> chúng tôi đề xuất khắc phục nhược điểm này bằng cách đưa vào mỗi hệ thống Web<br /> cache một Web cache cục bộ mở rộng LEWC (Local Extended Web Cache) để lưu<br /> tạm thời các đối tượng web bị loại bỏ khi thực hiện LRU hay LFU. Để áp dụng<br /> thay thế cache thuật toán SIZE liên kết kích thước cho từng đối tượng trong Web<br /> Cache, và sẽ loại bỏ đối tượng có kích thước lớn nhất và ít được tham chiếu gần<br /> đây nhất theo LRU. Thuật toán LRU-MIN lại loại bỏ các đối tượng có kích thước<br /> nhỏ nhất. Thực tế sự đa dạng của các đối tượng web, đặc biệt là các nội dung của<br /> các dịch vụ đa phương tiện, không làm cho các thuật toán này đạt được hiệu quả<br /> cao. Bởi vì ở một thời điểm một đối tượng web được coi là lớn nhất về kích thước<br /> nên bị loại bỏ, xong ở thời điểm khác nó không phải là lớn nhất.<br /> Hoặc ngược lại một đối tượng bị coi là nhỏ nhất và bị loại bỏ theo LRU-MIN,<br /> nhưng sau đó nó lại không phải là nhỏ nhất. Do đó giải pháp đưa vào LEWC có thể<br /> khắc phục đ ...

Tìm kiếm theo từ khóa liên quan:

Thuật toán thay thế Web caching LRU-EXT Internet Web caching Mạng tích hợp Tốc độ truy cập web Kiến trúc Internet web cachingTài liệu cùng danh mục:

-

Chương trình khung trình độ trung cấp nghề nghề Thiết kế trang Web - Trường CĐN GTVT Đường Thuỷ 1

6 trang 386 0 0 -

45 trang 370 4 0

-

Elasticity for MQTT brokers in IoT applications

13 trang 288 0 0 -

13 trang 270 0 0

-

A study on cloud computing security

15 trang 254 0 0 -

Đề thi thực hành môn Thiết kế Web - Trường Cao đẳng nghề Vĩnh Phúc

3 trang 252 2 0 -

EBay - Internet và câu chuyện thần kỳ: Phần 1

143 trang 249 0 0 -

8 trang 196 0 0

-

Tìm kiếm thông minh hơn với Google

4 trang 187 0 0 -

hướng dẫn đăng ký địa chỉ mail @fac.com

4 trang 177 0 0

Tài liệu mới:

-

Khảo sát tình trạng dinh dưỡng trước mổ ở người bệnh ung thư đại trực tràng

9 trang 20 0 0 -

94 trang 17 0 0

-

Tham vấn Thanh thiếu niên - ĐH Mở Bán công TP Hồ Chí Minh

276 trang 18 0 0 -

Kết hợp luân phiên sóng T và biến thiên nhịp tim trong tiên lượng bệnh nhân suy tim

10 trang 17 0 0 -

Đề thi giữa học kì 1 môn Ngữ văn lớp 9 năm 2024-2025 có đáp án - Trường THCS Nguyễn Trãi, Thanh Khê

14 trang 20 0 0 -

Đánh giá hiệu quả giải pháp phát triển thể chất cho sinh viên Trường Đại học Kiến trúc Hà Nội

8 trang 17 0 0 -

Tỉ lệ và các yếu tố liên quan đoạn chi dưới ở bệnh nhân đái tháo đường có loét chân

11 trang 18 0 0 -

39 trang 18 0 0

-

Đề thi học kì 1 môn Tiếng Anh lớp 6 năm 2024-2025 có đáp án - Trường TH&THCS Quang Trung, Hội An

6 trang 18 1 0 -

Tôm ram lá chanh vừa nhanh vừa dễRất dễ làm, nhanh gọn mà lại ngon. Nhà mình

7 trang 18 0 0