Bài giảng Truyền dẫn số: Chương 2 - Vũ Thị Thúy Hà

Thông tin tài liệu:

Nội dung trích xuất từ tài liệu:

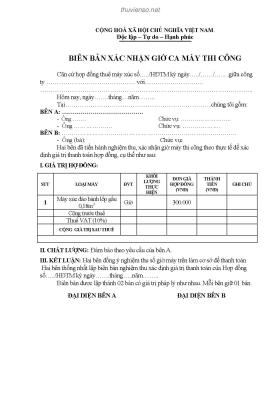

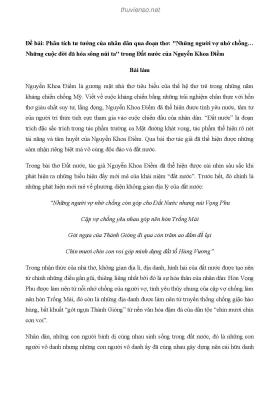

Bài giảng Truyền dẫn số: Chương 2 - Vũ Thị Thúy HàHỌC VIỆN CÔNG NGHỆ BƯU CHÍNH VIỄN THÔNG Bài giảng môn học TRUYỀN DẪN SỐ BM: TH & HT KHOA: VT1 Giảng viên: Vũ Thị Thúy Hà 1 1 Chương 2 MÃ HÓA NGUỒN Nội dung: 2.1 Mô hình toán học của nguồn tin 2.2 Đo lượng tin của nguồn tin 2.3 Các kỹ thuật mã hóa nguồn rời rạc 2.4 Các kỹ thuật mã hóa nguồn tương tự 2.5.Lấy mẫu và điều chế xung 2.6 Điều chế xung mã Bài tập2/11/2017 2 2 Chương 2 MÃ HÓA NGUỒN 2.1 Mô hình toán học của nguồn tin: Nguồn tin: Nguồn tương tự: tín hiệu ngõ ra có dạng liên tục Nguồn rời rạc: tín hiệu ngõ ra có dạng rời rạc Nguồn tin tạo ra các bản tin một cách ngẫu nhiên. Với nguồn rời rạc (Discrete source), ngõ ra là chuỗi các biến ngẫu nhiên rời rạc. Mô hình cho nguồn rời rạc: Giả sử nguồn rời rạc gồm L ký hiệu :{x1, x2,…, xL}, với xác suất tương ứng là {p1,p2,…,pL}. Lúc đó: L p k 1 k 1, k 1,..., L Ví dụ: Nguồn rời rạc nhị phân X sẽ gồm hai ký hiệu: {0,1} và P(X=0)+ P(X=1)=1. Nguồn rời rạc không nhớ DMS (Discrete Memoryless Source): phát ra chuỗi ký hiệu là độc lập thống kê, nghĩa là: P( xn | xn1 , xn2 ,...) P( xn )2/11/2017 3 3 Chương 2 MÃ HÓA NGUỒN 2.2 Đo lượng tin của nguồn tin: 2.2.1 Lượng tin của nguồn rời rạc: Tin tức liên quan đến sự ngạc nhiên mà chúng ta cảm nhận khi nhận được bản tin. Bản tin ít có khả năng xảy ra sẽ mang nhiều tin tức hơn. Từ đó, người ta đưa ra khái niệm lượng tin. Lượng tin: lượng tin riêng có được khi xuất hiện bản tin xi (xảy ra sự kiện X= xi ) 1 I ( xi ) log log P ( xi ) P ( xi ) • Đơn vị của lượng tin: Tùy vào cơ số hàm logarit (cơ số 2: đơn vị là bit, cơ số e: đơn vị là nat, cơ số 10: Hartley) • Tính chất: i/ I ( xi ) 0, 0 pi 1 ii/ I ( xi ) I ( x j ), pi p j2/11/2017 4 4 Chương 2 MÃ HÓA NGUỒN 2.2 Đo lượng tin của nguồn tin (tt): Lượng tin có điều kiện: lượng tin có được khi sự kiện X = xi xảy ra sau khi quan sát sự kiện Y = yj đã xảy ra. I ( xi | y j ) log P( xi | y j ) Lượng tin tương hỗ: lượng tin có được về sự kiện X =xi từ việc xảy ra sự kiện Y=yi. P ( xi ) I ( xi , y j ) I ( xi ) I ( xi | y j ) log P ( xi | y j ) Nhận xét: i/ Khi X, Y độc lập thống kê: I(xi,yj) = 0 ii/ I(xi,yj) = I(yj,xi) lượng tin về sự kiện X = xi có được từ việc xảy ra sự kiện Y = yj giống với lượng tin về sự kiện Y = yj có được từ việc xảy ra sự kiện X = xi.2/11/2017 5 5 Chương 2 MÃ HÓA NGUỒN 2.2 Đo lượng tin của nguồn tin (tt): Lượng tin trung bình: lượng tin trung bình chứa trong một ký hiệu bất kỳ của nguồn L I ( X ) P( xi ) log P( xi ) i 1 Nhận xét: lượng tin trung bình phản ánh được giá trị tin tức của cả nguồn tin. Ví dụ: Một nguồn DMS gồm 2 ký hiệu {x0,x1} với xác suất xuất hiện các ký hiệu tương ứng là 0.99 và 0.01. Lượng tin riêng của x1: I ( x1 ) log 2 [ p( x1 )] log 2 (0.01) 6.5 [bits / symbol ] Lượng tin trung bình của nguồn: I ( X ) 0.99log2 (0.99) 0.01log 2 (0.01) 0.081 [bits / symbol ] Lượng tin tương hỗ trung bình: L K I ( X , Y ) P ( xi , y j )I ( xi , y j ) i 1 j 12/11/2017 6 6 Chương 2 MÃ HÓA NGUỒN 2.2.2 Entropy của nguồn rời rạc: Giả sử nguồn rời rạc X gồm L ký hiệu {x1, x2,…, xL}, Entropy của nguồn X được định nghĩa là: L L H ( X ) P( xi ) log P( xi ) P( xi ) I ( xi ) i 1 i 1 Nhận xét: • Entropy của nguồn chính là lượng tin trung bình của nguồn đó. • H ( X ) log L .Nếu các ký hiệu của nguồn có xác suất xuất hiện bằng nhau thì Entropy sẽ đạt giá trị cực đại. L 1 1 1 P( xi ) , i 1,..., L H ( X ) log log L L i 1 L L • H ( X ) 0 . Dấu = xảy ra khi một ký hiệu có xác suất xuất hiện bằng 1, còn xác suất xuất hiện của các ký hiệu còn lại là 0.2/11/2017 7 7 Chương 2 MÃ HÓA NGUỒN 2.2.3 Entropy của nguồn liên tục: Giả sử nguồn liên tục X(t) có hàm mật độ phân bố xác suất của hàm mẫu x(t) là p( ...

Tìm kiếm theo từ khóa liên quan:

Bài giảng Truyền dẫn số Truyền dẫn số Mã hóa nguồn Kỹ thuật mã hóa nguồn Mã hóa nguồn rời rạc Phương pháp mã hóa Huffman Mã hóa số họcTài liệu cùng danh mục:

-

Tóm tắt về giảm bậc cho các mô hình: một giải pháp mang tính bình phẩm.

14 trang 463 0 0 -

33 trang 460 0 0

-

Đề cương chi tiết học phần Trí tuệ nhân tạo

12 trang 415 0 0 -

Kỹ thuật phân lớp để giải mã hiệu quả mã LDPC trong hệ thống thông tin di động 5G

13 trang 297 0 0 -

Đề cương chi tiết học phần Vi xử lý

12 trang 278 0 0 -

6 trang 238 0 0

-

Thiết kế mạch khuếch đại tạp âm thấp băng Ku ứng dụng cho hệ thống thu vệ tinh Vinasat

3 trang 222 0 0 -

Nghiên cứu giả lập thủ tục RACH trong mạng 5G

6 trang 211 0 0 -

Thiết kế mạch khuếch đại công suất băng S ứng dụng cho hệ thống thông tin di động 5G

3 trang 209 0 0 -

Thiết kế bộ lọc thông dải hốc cộng hưởng đồng trục cho băng C

8 trang 186 0 0

Tài liệu mới:

-

6 trang 0 0 0

-

Kết quả khởi phát chuyển dạ bằng oxytocin và dinoprostone trên thai trên 37 tuần

7 trang 0 0 0 -

Nghiên cứu chuyển đổi dạng bào chế của thược dược cam thảo thang sang dạng thạch

8 trang 0 0 0 -

7 trang 0 0 0

-

Kết quả điều trị dị dạng đường dẫn khí phổi bẩm sinh bằng phẫu thuật nội soi lồng ngực

6 trang 0 0 0 -

7 trang 0 0 0

-

6 trang 0 0 0

-

24 trang 2 0 0

-

48 trang 0 0 0

-

Đề thi học kì 1 môn Toán lớp 6 năm 2024-2025 có đáp án - Trường THCS Nguyễn Trãi, Núi Thành

24 trang 0 0 0