Sử dụng mạng nơ-ron nhân tạo nhiều tầng để dự báo giá nhà ở

Số trang: 9

Loại file: pdf

Dung lượng: 621.22 KB

Lượt xem: 27

Lượt tải: 0

Xem trước 2 trang đầu tiên của tài liệu này:

Thông tin tài liệu:

Bài viết "Sử dụng mạng nơ-ron nhân tạo nhiều tầng để dự báo giá nhà ở" giới thiệu về mô hình mạng nơ-ron nhiều tầng và cách áp dụng nó vào bài toán dự báo phân loại giá nhà với bộ số liệu giả định. Mời các bạn cùng tham khảo!

Nội dung trích xuất từ tài liệu:

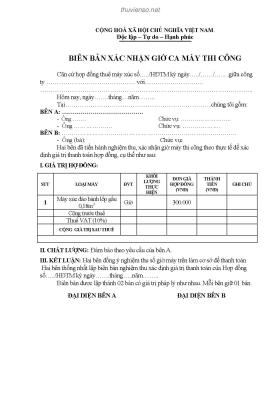

Sử dụng mạng nơ-ron nhân tạo nhiều tầng để dự báo giá nhà ở SỬ DỤNG MẠNG NƠ-RON NHÂN TẠO NHIỀU TẦNG ĐỂ DỰ BÁO GIÁ NHÀ Ở ThS. Lê Thị Thu Giang Bộ môn Toán, Đại học Thương mại Tóm tắt Mục đích chính của bài này là giới thiệu về mô hình mạng nơ-ron nhiều tầng và cách áp dụng nó vào bài toán dự báo phân loại giá nhà với bộ số liệu giả định được lấy từ trang web https://www.kaggle.com. Tác giả đã thử nghiệm bộ số liệu đó với 3 mô hình mạng nơ-ron khác nhau. Kết quả cho thấy các mô hình đều hoạt động tốt với độ chính xác trên tập kiểm tra khoảng 80%, trong đó mô hình có sử dụng tới tham số hiệu chỉnh cho kết quả ổn định hơn so với hai mô hình còn lại. Từ khóa: mạng nơ-ron , mạng nơ ron đa tầng, dự báo, dự báo giá nhà 1. Mở đầu Trong những năm gần đây, Học máy (Machine learning) đã trở thành một cách tiếp cận rất hiệu quả cho bài toán trong kinh tế, xã hội như: nhận dạng chữ viết tay, nhận dạng ngôn ngữ tự nhiên, gợi ý tìm kiếm trong mua-bán hàng hóa, dự báo giá cổ phiếu, giá bất động sản,… Trong số các thuật toán Học máy, mạng nơ-ron nhân tạo (ANN) được biết đến là một phương pháp rất hiệu quả vì nó có thể xấp xỉ được các lớp hàm phức tạp, phi tuyến ([1- 4]) nhờ vào khả năng học và tổng quát hóa của nó. Về cơ bản, một mạng nơ-ron nhân tạo bao gồm các nơ-ron đầu vào (như các khớp thần kinh), được nhân với các trọng số, chính là cường độ của các tín hiệu tương ứng, và sau đó được tính bằng một hàm toán học xác định sự kích hoạt của nơ-ron (activation function). Một hàm khác (có thể là hàm đồng nhất) sẽ tính toán đầu ra của tế bào thần kinh nhân tạo. Cấu trúc của một mạng nơ-ron nhân tạo sẽ gồm các thành phần sau đây: Các lớp: Ngoài lớp đầu vào (input layer) và lớp đầu ra (output layer), trong một mạng nơ-ron nhân tạo có thể có một hoặc nhiều lớp ẩn trung gian (hidden layers), những mạng nơ-ron như vậy được gọi là mạng nơ-ron đa tầng. Khi đó, mỗi đầu ra của lớp trước chính là đầu vào của lớp liền sau nó. Các nút: Mỗi điểm tròn trong hình 1 được gọi là một nút. Trong một lớp thường có nhiều nút và đầu ra lớp trước chính là các nút của lớp sau. Với bài toán dự báo giá, đầu ra ở lớp cuối (output) chỉ có một nút duy nhất, chính là giá trị dự đoán. Trọng số và hệ số điều chỉnh: Nếu mạng nơ-ron có L lớp thì tương ứng với nó sẽ có L ma trận trọng số. Ta kí hiệu là ma trận trọng số tại lớp thứ , các thành phần của ma trận trọng số của lớp này là , =. Như vậy, với mô hình mạng nơ-ron nhân tạo, số lượng tham số mô hình là rất lớn, chúng ta cần phải tìm ra tất cả các giá trị trọng số nói trên. 255 Hàm kích hoạt (activation function): Đầu ra tại lớp thứ l, ≥ 2, được tính theo công thức: −1 = ( + ) Trong đó, là một hàm kích hoạt tại lớp thứ . −1 và là các đầu ra thu được từ lớp thứ − 1 Thông thường, ta dùng một trong số các hàm phi tuyến sau đây làm hàm kích hoạt. - Hàm Sigmoid: ( ) = - Hàm Tanh: ℎ( ) = - Hàm ReLU: ( ) = max( , 0) Hàm Sigmoid và hàm Tanh đều là các hàm đối xứng, đơn điệu tăng và có đầu ra tiến tới 1 khi đầu vào rất lớn. Nếu như hàm Sigmoid chỉ nhận giá trị dương thì hàm Tanh lấy các giá trị trong khoảng [−1, 1]. Ưu điểm của các hàm này là cho đạo hàm rất đẹp và mô tả khá tốt những mô hình với biến đầu ra có dạng nhị phân hoặc các biểu diễn xác suất. Tuy nhiên, một nhược điểm rất dễ nhận thấy là khi đầu vào có giá trị tuyệt đối lớn, đạo hàm của hai loại hàm này rất gần với không. Điều này có nghĩa là các trọng số tương ứng với thành phần đang xét gần như không được cập nhật gần như không được cập, hay còn gọi là hiện tượng “Vanishing Gradient”. Gần đây, hàm ReLU (Rectified Linear Unit) được sử dụng rộng rãi vì tính đơn giản và hiệu quả của nó. Khi sử dụng hàm này trong các mạng nơ-ron đa tầng, tốc độ hội tụ cao hơn nhiều so với việc dùng hàm Tanh hay Sigmoid. Mặc dù hàm ReLU có nhược điểm là có đạo hàm bằng 0 với các giá trị âm, nhưng thực nghiệm cho thấy rằng, nhược điểm này có thể được khắc phục bằng cách tăng số nút ẩn. Có rất nhiều nghiên cứu đã được đưa ra cho thấy tính hiệu quả của ANNs trong dự báo giá nhà ở trong hơn 20 năm qua ([5-8]). Trong bài này, tác giả sẽ sử dụng ba mô hình mạng nơ-ron để phân loại giá nhà ở mức trên hay dưới mức trung bình dựa vào các yếu tố gắn với ngôi nhà đó như: diện tích nhà, diện tích nhà để xe, số phòng và các tiện ích khác. 2. Phương pháp xây dựng mô hình 2.1. Thuật toán Lan truyền ngược (Backpropagation) Kí hiệu , là cặp dữ liệu huấn luyện, , là ma trận bao gồm tất cả các trọng số ở L lớp (mỗi cột là bộ trọng số tương ứng với lớp thứ ). Khi đó, quá trình lan truyền thuận (forwardpropagation) được thực hiện qua phép lặp sau 0 Khởi tạo := −1 := + , = 1, ⋯ , ≔ ( ) ≔ Hàm số biểu diễn sai số giữa kết quả tính toán bằng mô hình với kết quả thực tế được gọi là hàm mất mát ký hiệu ( , , , ) . Có nhiều cách xây dựng hàm mất mát. Một trong những 256 cách thiết lập hàm mất mát thông dụng nhất là ta lấy trung bình bình phương sai số giữa kết quả tính toán với kết quả thực tế của dữ liệu đầu vào (MSE-mean square error): 1 ( , , , )= ‖ − ‖ Trong đó, là giá trị tại một hàm hợp của L hàm kích hoạt dạng ( + ), nó cũng là giá trị xấp xỉ của qua mô hình. Thuật toán backpropagation (Rumelhart và McClelland, 1986) được dùng trong feed-forward ANNs. Các tế ...

Nội dung trích xuất từ tài liệu:

Sử dụng mạng nơ-ron nhân tạo nhiều tầng để dự báo giá nhà ở SỬ DỤNG MẠNG NƠ-RON NHÂN TẠO NHIỀU TẦNG ĐỂ DỰ BÁO GIÁ NHÀ Ở ThS. Lê Thị Thu Giang Bộ môn Toán, Đại học Thương mại Tóm tắt Mục đích chính của bài này là giới thiệu về mô hình mạng nơ-ron nhiều tầng và cách áp dụng nó vào bài toán dự báo phân loại giá nhà với bộ số liệu giả định được lấy từ trang web https://www.kaggle.com. Tác giả đã thử nghiệm bộ số liệu đó với 3 mô hình mạng nơ-ron khác nhau. Kết quả cho thấy các mô hình đều hoạt động tốt với độ chính xác trên tập kiểm tra khoảng 80%, trong đó mô hình có sử dụng tới tham số hiệu chỉnh cho kết quả ổn định hơn so với hai mô hình còn lại. Từ khóa: mạng nơ-ron , mạng nơ ron đa tầng, dự báo, dự báo giá nhà 1. Mở đầu Trong những năm gần đây, Học máy (Machine learning) đã trở thành một cách tiếp cận rất hiệu quả cho bài toán trong kinh tế, xã hội như: nhận dạng chữ viết tay, nhận dạng ngôn ngữ tự nhiên, gợi ý tìm kiếm trong mua-bán hàng hóa, dự báo giá cổ phiếu, giá bất động sản,… Trong số các thuật toán Học máy, mạng nơ-ron nhân tạo (ANN) được biết đến là một phương pháp rất hiệu quả vì nó có thể xấp xỉ được các lớp hàm phức tạp, phi tuyến ([1- 4]) nhờ vào khả năng học và tổng quát hóa của nó. Về cơ bản, một mạng nơ-ron nhân tạo bao gồm các nơ-ron đầu vào (như các khớp thần kinh), được nhân với các trọng số, chính là cường độ của các tín hiệu tương ứng, và sau đó được tính bằng một hàm toán học xác định sự kích hoạt của nơ-ron (activation function). Một hàm khác (có thể là hàm đồng nhất) sẽ tính toán đầu ra của tế bào thần kinh nhân tạo. Cấu trúc của một mạng nơ-ron nhân tạo sẽ gồm các thành phần sau đây: Các lớp: Ngoài lớp đầu vào (input layer) và lớp đầu ra (output layer), trong một mạng nơ-ron nhân tạo có thể có một hoặc nhiều lớp ẩn trung gian (hidden layers), những mạng nơ-ron như vậy được gọi là mạng nơ-ron đa tầng. Khi đó, mỗi đầu ra của lớp trước chính là đầu vào của lớp liền sau nó. Các nút: Mỗi điểm tròn trong hình 1 được gọi là một nút. Trong một lớp thường có nhiều nút và đầu ra lớp trước chính là các nút của lớp sau. Với bài toán dự báo giá, đầu ra ở lớp cuối (output) chỉ có một nút duy nhất, chính là giá trị dự đoán. Trọng số và hệ số điều chỉnh: Nếu mạng nơ-ron có L lớp thì tương ứng với nó sẽ có L ma trận trọng số. Ta kí hiệu là ma trận trọng số tại lớp thứ , các thành phần của ma trận trọng số của lớp này là , =. Như vậy, với mô hình mạng nơ-ron nhân tạo, số lượng tham số mô hình là rất lớn, chúng ta cần phải tìm ra tất cả các giá trị trọng số nói trên. 255 Hàm kích hoạt (activation function): Đầu ra tại lớp thứ l, ≥ 2, được tính theo công thức: −1 = ( + ) Trong đó, là một hàm kích hoạt tại lớp thứ . −1 và là các đầu ra thu được từ lớp thứ − 1 Thông thường, ta dùng một trong số các hàm phi tuyến sau đây làm hàm kích hoạt. - Hàm Sigmoid: ( ) = - Hàm Tanh: ℎ( ) = - Hàm ReLU: ( ) = max( , 0) Hàm Sigmoid và hàm Tanh đều là các hàm đối xứng, đơn điệu tăng và có đầu ra tiến tới 1 khi đầu vào rất lớn. Nếu như hàm Sigmoid chỉ nhận giá trị dương thì hàm Tanh lấy các giá trị trong khoảng [−1, 1]. Ưu điểm của các hàm này là cho đạo hàm rất đẹp và mô tả khá tốt những mô hình với biến đầu ra có dạng nhị phân hoặc các biểu diễn xác suất. Tuy nhiên, một nhược điểm rất dễ nhận thấy là khi đầu vào có giá trị tuyệt đối lớn, đạo hàm của hai loại hàm này rất gần với không. Điều này có nghĩa là các trọng số tương ứng với thành phần đang xét gần như không được cập nhật gần như không được cập, hay còn gọi là hiện tượng “Vanishing Gradient”. Gần đây, hàm ReLU (Rectified Linear Unit) được sử dụng rộng rãi vì tính đơn giản và hiệu quả của nó. Khi sử dụng hàm này trong các mạng nơ-ron đa tầng, tốc độ hội tụ cao hơn nhiều so với việc dùng hàm Tanh hay Sigmoid. Mặc dù hàm ReLU có nhược điểm là có đạo hàm bằng 0 với các giá trị âm, nhưng thực nghiệm cho thấy rằng, nhược điểm này có thể được khắc phục bằng cách tăng số nút ẩn. Có rất nhiều nghiên cứu đã được đưa ra cho thấy tính hiệu quả của ANNs trong dự báo giá nhà ở trong hơn 20 năm qua ([5-8]). Trong bài này, tác giả sẽ sử dụng ba mô hình mạng nơ-ron để phân loại giá nhà ở mức trên hay dưới mức trung bình dựa vào các yếu tố gắn với ngôi nhà đó như: diện tích nhà, diện tích nhà để xe, số phòng và các tiện ích khác. 2. Phương pháp xây dựng mô hình 2.1. Thuật toán Lan truyền ngược (Backpropagation) Kí hiệu , là cặp dữ liệu huấn luyện, , là ma trận bao gồm tất cả các trọng số ở L lớp (mỗi cột là bộ trọng số tương ứng với lớp thứ ). Khi đó, quá trình lan truyền thuận (forwardpropagation) được thực hiện qua phép lặp sau 0 Khởi tạo := −1 := + , = 1, ⋯ , ≔ ( ) ≔ Hàm số biểu diễn sai số giữa kết quả tính toán bằng mô hình với kết quả thực tế được gọi là hàm mất mát ký hiệu ( , , , ) . Có nhiều cách xây dựng hàm mất mát. Một trong những 256 cách thiết lập hàm mất mát thông dụng nhất là ta lấy trung bình bình phương sai số giữa kết quả tính toán với kết quả thực tế của dữ liệu đầu vào (MSE-mean square error): 1 ( , , , )= ‖ − ‖ Trong đó, là giá trị tại một hàm hợp của L hàm kích hoạt dạng ( + ), nó cũng là giá trị xấp xỉ của qua mô hình. Thuật toán backpropagation (Rumelhart và McClelland, 1986) được dùng trong feed-forward ANNs. Các tế ...

Tìm kiếm theo từ khóa liên quan:

Kỷ yếu Hội thảo khoa học Hội thảo khoa học về Thương mại Mạng nơ-ron nhân tạo Dự báo giá nhà ở Thuật toán Học máy Mạng nơ-ron đa tầngGợi ý tài liệu liên quan:

-

Yếu tố nhận diện người thứ ba ngay tình trong giao dịch dân sự

11 trang 305 0 0 -

197 trang 273 0 0

-

Cách tính nhanh giá trị riêng của ma trận vuông cấp 2 và cấp 3

4 trang 252 0 0 -

Một số vấn đề về chuyển đổi số và ứng dụng trong doanh nghiệp

11 trang 247 0 0 -

Quản lý dữ liệu thông tin người hưởng bảo hiểm xã hội

6 trang 222 0 0 -

Thuật toán khai phá tập mục thường xuyên trong cơ sở dữ liệu lớn thông qua mẫu đại diện

11 trang 205 0 0 -

11 trang 204 0 0

-

Phương pháp nhận diện biển số xe ô tô sử dụng học máy và thư viện OpenCV

6 trang 191 0 0 -

Nghi thức chào hỏi trong văn hóa giao tiếp của người Nhật

13 trang 139 0 0 -

Sản xuất và chế biến thực phẩm sạch - Kỷ yếu hội thảo khoa học: Phần 2

153 trang 130 0 0